Listeners:

Principales oyentes:

00:00

00:00

volume_up

chevron_left

-

play_arrow

play_arrow

EN DIRECTO La Primera de Bizkaia

-

play_arrow

play_arrow

La Agenda de Alazne 09-04-2026 Egunon Bizkaia

-

play_arrow

play_arrow

El ingenio salvaje de Mr. Fox Arrastion Bizkaia

-

play_arrow

play_arrow

Sin malos rollos: Hay que reírse... incluso de uno mismo Arrastion Bizkaia

-

play_arrow

play_arrow

Rafaela y su loco mundo, pop, caos y personalidad Arrastion Bizkaia

-

play_arrow

play_arrow

Cuando la envidia se vuelve comedia Arrastion Bizkaia

-

play_arrow

play_arrow

Risas con 50 sombras muy oscuras Arrastion Bizkaia

-

play_arrow

play_arrow

La agenda de Alazne 05-03-2026 Egunon Bizkaia

-

play_arrow

play_arrow

Drácula: la reinvención de un mito eterno Arrastion Bizkaia

-

play_arrow

play_arrow

Entre el miedo y la memoria: Vieja loca, un thriller que te atrapa Arrastion Bizkaia

-

play_arrow

play_arrow

Galdakao activa el proceso participativo para elegir los conciertos de Santakurtzak 2026 Egunon Bizkaia

share

close

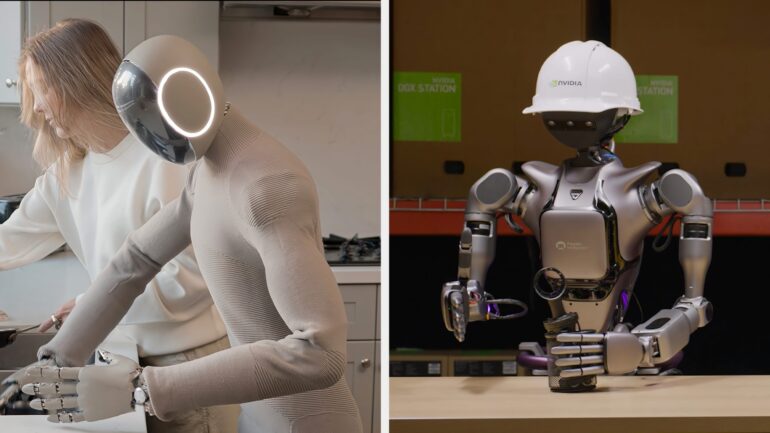

Tras la presentación con bombos y platillos de los modelos de inteligencia artificial Alia, financiados por el Gobierno de España, la polémica no se hizo esperar. En las últimas horas, se ha desatado gran revuelo por su pobre desempeño al compararlo con otras IA de cierta antigüedad como Llama 2 32B, que Meta lanzó en julio de 2023.

Pero la historia no concluye allí, puesto que los costes de Alia también son motivo de controversia. Si bien no existe un dato preciso al respecto, se estima que ya se destinaron más de 10 millones de euros al desarrollo de esta inteligencia artificial. Una cifra que podría ser todavía mayor y que expertos de la industria consideran muy elevada para los resultados que está entregando la tecnología.

Entre los primeros comentarios críticos contra Alia se mencionó que sería un mero fine tuning —es decir, una versión personalizada— de Llama, la IA de Meta. No obstante, la página del modelo en Hugging Face afirma que se ha preentrenado desde cero usando sets de datos curados de forma manual. Lo que sí se habría aprovechado sería el tokenizador de la familia de modelos creados por la firma de Mark Zuckerberg.

Sobre este asunto, el ingeniero Ramón Medrano Llamas, de Google, brindó su punto de vista a través de su cuenta de X (Twitter). «Los modelos [por Alia] son bien malos, pero una nota: que usen el tokenizer de Llama no implica que sean un fine tune. De hecho, si fueran un fine tune con 17B tokens buenos, los resultados serían mucho mejores y a 1/100 de coste. Es lo que hizo Francia, por cierto», publicó.

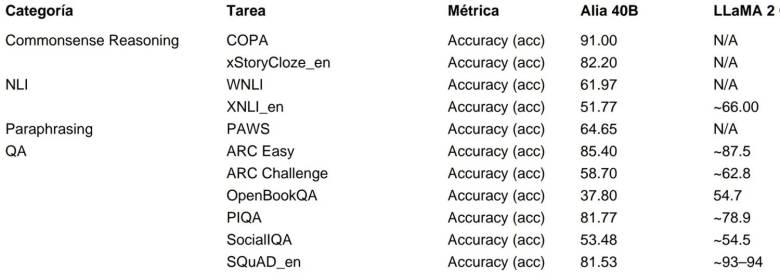

Los benchmarks de Alia son peores que los de Llama 2 32B, de 2023

Entre las críticas a los benchmarks de Alia ha destacado la de Javier López, fundador de Magnific AI. El susodicho compartió una captura de pantalla en la que se podían observar los resultados de algunas pruebas en inglés de la IA española, comparada contra la versión de 32.000 millones de parámetros de Llama 2.

La tabla en cuestión mostraba que, en los parámetros en los que había posibilidad de contrastar el rendimiento entre ambos modelos, los resultados de Alia eran peores que los de la inteligencia artificial de Meta al medirlos según su precisión. Como indicamos al comienzo, los de Menlo Park lanzaron dicha versión en julio de 2023, de modo que ya no es una referencia top de la industria.

Tal y como indica la imagen, los ejemplos más contundentes del bajo desempeño de Alia en comparación con Llama 2 32B corresponden al entendimiento e interpretación del lenguaje natural (NLI) y a la creación de respuestas a preguntas (QA). Un punto interesante a considerar es que las tablas de Alia en Hugging Face han dejado de incluir la columna comparativa con el modelo de Meta, al menos al momento de redacción de este artículo.

Ya veremos si los responsables de la nueva IA financiada por el Gobierno de España salen a responder, o si el asunto continúa generando todo tipo de comentarios entre el público.

Escrito por Mozoilo Irratia

Publicaciones similares

EN DIRECTO

Hitz eta Pitz!

con Maria Lauzirika y compañía

Tardes de tertúlia y música de 6 a 8 y de lunes a viernes con María Lauzirika y compañía!

closesiguientes programas

Arrastion Bizkaia!

¡La música más fresca!

15:00 - 17:00

Eduardo Bilbao!

Arrastion Bizkaia!

17:00 - 20:00

Cara B

con David Parra

20:00 - 21:00

La Isla del Tesoro

con Kike Peris

21:00 - 22:00

Hip Hop Gaua

por Unai Parra

22:00 - 00:00ÚLTIMAS NOTICIAS

Detienen a un hombre por una presunta agresión sexual a una joven en Santurtzi

Desarticulada una organización criminal en Bizkaia con la incautación de 300 kilos de speed

Desmantelada en Ortuella una ruta de narcotráfico hacia Navarra con un detenido de 76 años

Berriz clama justicia tras el intento de asesinato de una mujer

EL AYUNTAMIENTO DE BILBAO INICIA LA CONSTRUCCIÓN DE UNA NUEVA ROTONDA EN EL CRUCE DE LAS CALLES SAN ISIDRO Y PÁRROCO UGAZ, EN EL BARRIO DE ZURBARAN

LISTA MUSICAL

Copyright Mozoilo Irratia

Comentarios de las entradas (0)