Listeners:

Principales oyentes:

00:00

00:00

volume_up

chevron_left

-

play_arrow

play_arrow

EN DIRECTO La Primera de Bizkaia

-

play_arrow

play_arrow

Cómo superar el duelo por una amistad

-

play_arrow

play_arrow

La Agenda de Alazne 14-05-2026 Egunon Bizkaia

-

play_arrow

play_arrow

Lola Dacosta tiene nuevo podcast Egunon Bizkaia

-

play_arrow

play_arrow

La agenda de Alazne 30-04-2026 Egunon Bizkaia

-

play_arrow

play_arrow

La agenda de Alazne 23-04-2026 Egunon Bizkaia

-

play_arrow

play_arrow

La Agenda de Alazne 09-04-2026 Egunon Bizkaia

-

play_arrow

play_arrow

Aquí no queda ni el apuntador

-

play_arrow

play_arrow

Psicología: Grandes Hermanos, vidas prestada, el negoncio de las emociones

-

play_arrow

play_arrow

Etiquetas diagnosticas o para qué juzgamos a a la gente

-

play_arrow

play_arrow

El ingenio salvaje de Mr. Fox Arrastion Bizkaia

share

close

DeepSeek está robándose la atención de todos los entusiastas de la inteligencia artificial. El nuevo modelo desarrollado en China ha dejado en ridículo a competidores como OpenAI o Google y se perfila como un nuevo titán en la industria. Curiosamente, la empresa china Alibaba quiso aprovechar el furor por DeepSeek para presentar su nuevo modelo de IA.

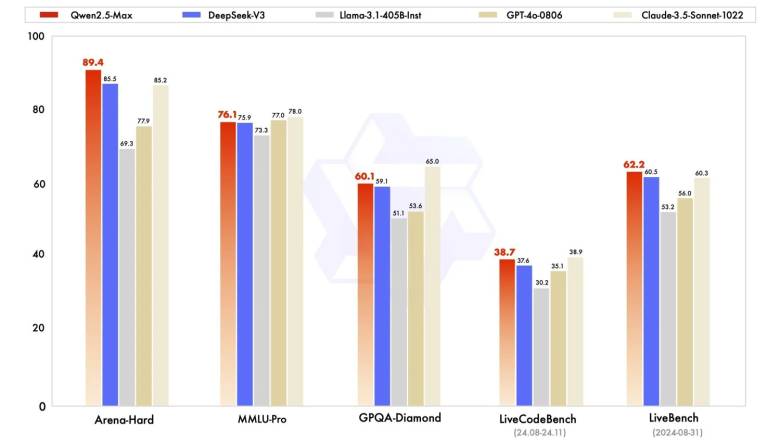

Alibaba anunció hoy el lanzamiento de Qwen2.5-Max, un modelo MoE entrenado en más de 20 billones de tokens. La compañía afirma que su nueva IA supera a DeepSeek V3 en varios benchmarks, incluyendo pruebas de conocimiento general y resolución de problemas. Alibaba añadió que su modelo se entrenó con metodologías seleccionadas de Ajuste Fino Supervisado (SFT) y Aprendizaje de Refuerzo a Partir de Retroalimentación Humana (RLHF).

Si bien Alibaba ya lleva un tiempo trabajando en modelos de lenguaje, ninguno había conseguido acaparar los reflectores como lo hizo DeepSeek. Es por ello que el gigante chino publicó una actualización en su cuenta de X para gritarle al mundo que ellos también desarrollan productos competitivos.

«El lanzamiento de DeepSeek V3 ha atraído la atención de toda la comunidad de IA hacia los modelos MoE a gran escala. Al mismo tiempo, hemos estado construyendo Qwen2.5-Max, un gran LLM de MoE preentrenado con datos masivos y postentrenado con recetas SFT y RLHF seleccionadas. Logra un rendimiento competitivo frente a los modelos de primer nivel y supera a DeepSeek V3 en benchmarks como Arena Hard, LiveBench, LiveCodeBench y GPQA-Diamond»

La IA de Alibaba promete superar a DeepSeek

De acuerdo con Alibaba, Qwen2.5-Max ha sido diseñado para sobresalir en una variedad de escenarios, desde tareas complejas basadas en conocimiento hasta la generación de código. Cuando se compara con competidores como DeepSeek V3, GPT-4o y Claude-3.5-Sonnet, Qwen2.5-Max ofrece resultados sólidos en benchmarks como Arena-Hard, LiveBench, LiveCodeBench y GPQA-Diamond.

Sus creadores señalan que Qwen2.5-Max tiene un rendimiento superior frente a modelos de código abierto, como DeepSeek V3, Llama-3.1-405B y Qwen2.5-72B. Alibaba los ha puesto a competir en pruebas de conocimiento académico a nivel universitario, toma de decisiones, habilidades de programación y capacidad de uso general.

Qwen2.5-Max está disponible al público general a través de Qwen Chat, un chatbot similar a ChatGPT y DeepSeek que ofrece funciones de búsqueda web, generación de imágenes, videos y artefactos. Este último produce imágenes con propiedades físicas a través de código en JavaScript, por ejemplo, una función que genere emojis cada vez que haces clic en la pantalla.

Cómo funciona Qwen2.5-Max, la IA que compite con DeepSeek

Al igual que DeepSeek, Qwen2.5-Max utiliza MoE, una técnica de aprendizaje automático que busca mejorar la eficiencia y rendimiento de los modelos de lenguaje grande (LLM). En lugar de utilizar una única red neuronal para procesar toda la información, MoE divide el modelo en múltiples subredes especializadas, cada una actuando como un «experto» en un subconjunto específico de datos.

Estos expertos se gestionan a través de una red de enrutamiento que determina cuál de ellos es el más adecuado para procesar una entrada determinada. Por ejemplo, un experto (o subred) puede estar diseñado para comprender lenguaje natural, mientras que otro se especializa en lenguaje técnico o cotidiano. Posteriormente, estas salidas se combinan dependiendo de los pesos asignados por la red, generando una salida final.

De acuerdo con Alibaba, MoE permite crear modelos grandes más eficientes y flexibles. Al activar solo los expertos necesarios, la técnica reduce el coste computacional. Además, el modelo puede adaptarse a diferentes tipos de datos y tareas, agregando o eliminando expertos según sea necesario.

La nueva IA de Alibaba es gratis y solo requiere crearse una cuenta de usuario con tu correo electrónico de Google o GitHub. A diferencia de OpenAI, los usuarios pueden elegir Qwen2.5-Max como el modelo predeterminado y aprovechar sus capacidades sin coste adicional.

Escrito por Mozoilo Irratia

Publicaciones similares

EN DIRECTO

siguientes programas

Dantza Bizkaia!

20:00 - 22:00

Ambulance

Dj Anna Lee

22:00 - 23:00

Dj Anja Schneider

23:00 - 00:00

The Essential Mix

00:00 - 02:00

Noche de House

02:00 - 04:00

ÚLTIMAS NOTICIAS

LAS VISITAS GUIADAS DEL PROGRAMA “BILBAO IZAN” CONTINUAN EN JUNIO POR EL BARRIO DE SANTUTXU

JÓVENES DE BILBAO MUESTRAN MÁS DE 30 PROYECTOS CIENTÍFICO-TECNOLÓGICOS EN EL “BIZILABE EGUNA”

CARLOS URGOITI, NUEVO CONCEJAL DE HACIENDA EN EL AYUNTAMIENTO DE BILBAO

EL “WARMING UP” DEL BBK LEGENDS BILBAO VOLVERÁ A LLENAR BILBAO DE MÚSICA DESDE UN AUTOBÚS ITINERANTE

EL AYUNTAMIENTO DE BILBAO AMPLÍA LA OFERTA DE COLONIAS DE VERANO CON CAMPUS ESPECÍFICOS DE EUSKAL PILOTA, ATLETISMO Y SKATE

LISTA MUSICAL

Copyright Mozoilo Irratia

Comentarios de las entradas (0)